Ebben a bemutatóban egy vadonatúj, nyílt forráskódú nyelvi modellt ismerhetünk meg, amely a legfrissebb, 27 milliárd paraméteres kategóriában versenyez. A szerző részletesen kifejti, hogy milyen innovatív, hibrid architektúrát alkalmaz: hagyományos és lineáris figyelmi rétegek kombinációját, valamint egy úgynevezett gated delta network megközelítést, amely gyorsabb működést és hatékonyabb memóriahasználatot biztosít.

A telepítési folyamat lépésről lépésre követhető egy Ubuntu rendszerű, Nvidia RTX A6000 GPU-val felszerelt gépen. A bemutatott eszköz a llama.cpp, amely lehetővé teszi a modell futtatását helyben – akár CPU-n, akár GPU-n. A videóban szó esik a kvantálásról (Q8), a VRAM- és CPU-erőforrás-felhasználásról, illetve különböző tesztelési módokról.

A tesztek során a modell teljesítményét többféle feladaton vizsgálják, beleértve a kódgenerálást (HTML akvárium animáció), történelmi események feldolgozását, nyelvi teszteket és fordítási feladatokat is. Részletes figyelmet kap, hogyan kezel mélyebb logikai, komplex nyelvi és többrétegű feladatokat, valamint hogyan priorizálja a pontosságot és az önreflexiót, miközben akár több mint 200 nyelven képes működni, multimodális támogatással.

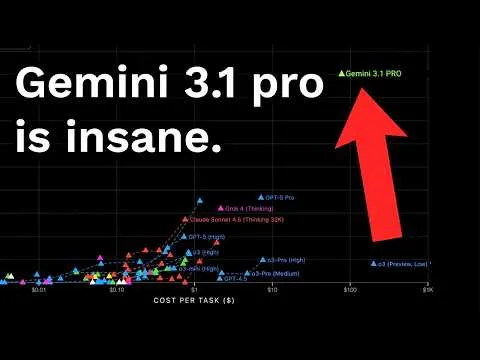

Felmerülnek kérdések a kvantálás hatékonyságáról, a modell sebességéről CPU-n és GPU-n, illetve hogyan teljesít a különböző benchmarkokon más, akár sokkal nagyobb modellekkel szemben. A bemutatott tapasztalatok alapján a közönség arra is ösztönözve van, hogy saját nyelvén ellenőrizze a fordítások minőségét, megosztva visszajelzéseit a további fejlesztésekhez.